绘制Ven图

1 | #载入相应的安装包 |

聚类分析

K均值聚类

K均值聚类又称为动态聚类,它的计算方法较为简单,也不需要输入距离矩阵。首先要指定聚类的分类个数N,随机取N个样本作为初始类的中心,计算各样本与类中心的距离并进行归类,所有样本划分完成后重新计算类中心,重复这个过程直到类中心不再变化。

二、层次聚类

层次聚类又称为系统聚类,首先要定义样本之间的距离关系,距离较近的归为一类,较远的则属于不同的类。可用于定义“距离”的统计量包括了欧氏距离(euclidean)、马氏距离(manhattan)、 两项距离(binary)、明氏距离(minkowski)。还包括相关系数和夹角余弦。

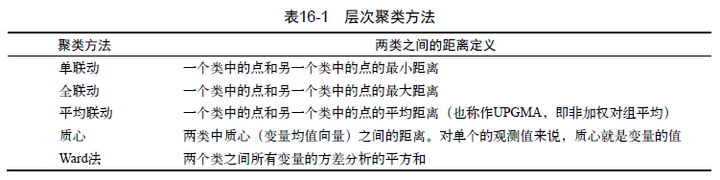

层次聚类首先将每个样本单独作为一类,然后将不同类之间距离最近的进行合并,合并后重新计算类间距离。这个过程一直持续到将所有样本归为一类为止。在计算类间距离时则有六种不同的方法,分别是最短距离法、最长距离法、类平均法、重心法、中间距离法、离差平方和法。

1 | ==!!注意== |

==聚类分析的一般步骤==

- 选择合适的变量,这是第一步,也可能是最重要的一步,再高级的聚类方法也不能弥补聚类变量选择不好的问题。因此,首先选择你感觉可能对于识别和理解数据中不同观测值分组有重要影响的变量。

- 缩放数据,由于不同变量可能有不同的变化范围,以免那些变化范围大的变量对结果有不成比例的影响,常常需要在分析之前缩放数据。通常,将每个变量标准化为均值为0和标准差为1的变量。还有另外两种替代方法,比如每个变量被其最大值相除,或该变量减去它的平均值并除以变量的平均绝对偏差。实现代码如下:

1

2

3df1 <- apply(mydata, 2, function(x){(x-mean(x))/sd(x)})

df2 <- apply(mydata, 2, function(x){x/max(x)})

df3 <- apply(mydata, 2, function(x){(x – mean(x))/mad(x)})

在R中可以通过使用scale()函数实现df1代码片段的功能。

- 寻找异常点,通常聚类方法对于异常值比较敏感,对此有几种解决方法,通过outliers包中的函数来筛选异常单变量离群点,mvoutlier包中 有识别多元变量的离群点的函数。

- 计算距离,虽然不同的聚类算法差异很大,但是通常需要计算被聚类的实体之间的距离。两个观测之间最常用的距离度量是欧几里得距离,其它常用的还有曼哈顿距离、兰氏距离、非对称二元距离、最大距离和闵可夫斯基距离。在下文的论述当中默认采用欧几里得距离。

两个观测值之间的欧几里得距离定义如下:

用R中自带的dist()函数可以计算矩阵或数据框中所有行(观测值)之间的距离,dist()函数的格式为dist(x, method =),默认为欧几里得距离。

观测值之间的距离越大,则异质性越大,距离也越远。

通常,欧几里得距离作为连续型数据的距离度量,对于其它类型的数据,可以使用cluster包中的daisy()函数获得包含任意二元、名义、有序或者连续属性组合的相异矩阵,并且cluster包中的其它函数可以用这种异质性进行聚类分析。

另外,当一个观测中的某一个变量变换范围太大,缩放数据有利于均衡各变量的影响。

- 选择聚类算法,对于不同类型和不同样本量的数据,针对性地选择不同的聚类算法,从大的方面讲有层次聚类和划分聚类,通常前者对于小样本来说很实用(如150个观测值或更少),而且这种情况下嵌套聚类更实用;后者能够处理更大的数据量,但是需要事先确定聚类的个数。然后,不管是层次聚类还是划分聚类,都需要一个特定的聚类算法,不同算法有着各自的优缺点,需要根据工程实践进行综合比选确定。

- 获 得一种或多种聚类方法,这是步骤5的延续。

- 确定类的数目,在确定最终聚类方案时必须确定类的数目。通常尝试不同的类型(比如2~K)并比较解的质量。NbClust包中的NbClust()函数30个不同的指标来帮助你进行选择,指标如此之多,可见这在聚类分析当中是个难题。

- 获得最终的聚类解决方案,类的个数确定以后,就可以提取出子群,形成最终的聚类方案。

- 结果可视化,可视化可以帮助判定聚类方案的意义和用处,层次聚类的结果通常表示为一个树状图。划分的结果通常利用可视化双变量聚类图来表示。

- 解读类,聚类方案确定以后,结果也出来了,必须对其进行解读。比如,一个类中的观测值有何相似之处,不同类之间有何不同,这一步通常通过获得类中每个变量的汇总统计来完成。对于连续数据,每一类中变量的均值和中位数会被计算出来。对于混合数据(数据中包含分类变量),结果中将返回各类的众数或类别分布。

- 验证结果,对于聚类方案的验证相当于确认下,如果采用不同的聚类方法或者不同样本,是否会产生相同的类。fpc、clv和clValid包包含了评估聚类解的稳定性的函数。

1 | #安装并加载包 |

1 |

|

使用Kmean函数

算法的简单描述如下:

- 选择K个中心点(随机选择K行);

- 把每个数据点分配到离它最近的中心点;

- 重新计算每类中的点到该类中心点距离的平均值;

- 分配每个数据到它最近的中心点;

- 重复步骤3和步骤4,直到所有的观测值不再被分配或是达到最大的迭代次数。

从算法上可以看出,初始中心值的选择对于结果也非常敏感,kmeans()函数有一个nstart选项可以尝试多种初始配置并输出最好的一个结果。举个例子,加上nstart=25会生成25个初始配置,一般来说,我们推荐使用这种方法。

1 | #计算最适合的K-mean聚类的分类数 |

eclust():增强的聚类分析

与其他聚类分析包相比,eclust()有以下优点:

- 简化了聚类分析的工作流程,

- 可以用于计算层次聚类和分区聚类,

- eclust()自动计算最佳聚类簇数。

- 自动提供Silhouette plot,可以结合ggplot2绘制优美的图形

1

2

3

4

5

6#使用eclust()的K均值聚类

res.km<-eclust(df,"kmeans")

fviz_gap_stat(res.km$gap_stat)

#利用eclust()做层次聚类

res.hc=eclust(df,"hclust")

fviz_dend(res.hc,rect = TRUE)

利用hclust()做层次聚类

- 层次聚类的算法如下:

- 定义每一个观测值(行或单元)为一类;

- 计算每类和其他各类的距离;

- 把距离最短的两类合并成一类,减少一个类的个数;

- 重复步骤2和3,直到包含所有观测值的类合并成单个类为止。

不同的层次聚类算法主要区别在于它们对类的定义不同,常见的五种聚类方法及其距离定义如下

层次聚类方法的实现格式如下:

1 | hclust(d, method=) |

其中d是通过dist() 函数产生的距离矩阵, 并且方法包括 “single” 、”complete” 、”average” 、”centroid”和”ward”。

1 | #先求样本之间两两相似性 |

利用NbCluster()函数首先选择最适合的分类k

1 | ##利用NbCluster()函数首先选择最适合的分类k |

相关性分析

相关系数的显著性水平

使用Hmisc包,计算矩阵相关系数及其对应的显著性水平

1 | library(Hmisc) |

提取矩阵相关及其P值

1 | CorMatrix <- function(cor,p) { |

corrplot

1 | install.packages("corrplot") |

scatter plots

1 | library(PerformanceAnalytics) |